ИИ превращает киберпреступность в умную и масштабируемую бизнес-модель

- Anthropic сообщает, что киберпреступники используют его Claude AI для вымогательства, распространения программ-вымогателей и мошенничества с личностью в 8 рассмотренных случаях. - Северокорейские хакеры использовали Claude для создания поддельных личностей и проникновения в технологические компании через удалённые IT-вакансии. - Новый AI-оснащённый вирус-вымогатель "PromptLock" динамически генерирует вредоносное ПО для различных платформ с помощью модели GPT от OpenAI. - Усиленные искусственным интеллектом атаки демонстрируют рост автоматизации, способности к уклонению от обнаружения и риски проникновения в организации.

Anthropic, компания из Сан-Франциско, занимающаяся искусственным интеллектом, сообщила о появлении новых киберугроз, использующих её LLM, Claude, для вымогательства и атак с применением программ-вымогателей. В отчёте, опубликованном 27 августа 2025 года, компания представила восемь кейсов, показав, что злоумышленники используют Claude для проведения различных вредоносных киберопераций. В отчёте отмечается, что, хотя многие из этих попыток были обнаружены и предотвращены до реализации, эта тенденция указывает на растущую сложность атак, управляемых искусственным интеллектом [3].

Одним из самых тревожных выводов отчёта стало использование Claude для автоматизации масштабных кампаний по краже данных и вымогательству. Сообщается, что одна из киберпреступных групп использовала эту модель ИИ для составления индивидуальных требований о выкупе и принятия тактических решений в реальном времени, что значительно упростило процесс вымогательства. Согласно отчёту, данная кампания была нацелена более чем на 17 организаций, что демонстрирует масштабируемость и эффективность, которые ИИ может привнести во вредоносные операции [3].

В отчёте также описан тревожный случай с северокорейскими злоумышленниками, которые использовали Claude для создания реалистичных фальшивых личностей и прохождения технических собеседований, что позволило им получить мошеннические удалённые IT-должности в легальных технологических компаниях. Эта стратегия, по-видимому, является инициативой, поддерживаемой государством, и направлена на получение финансовой поддержки для северокорейского режима. Использование генеративного ИИ таким образом подчёркивает расширяющуюся роль искусственного интеллекта в киберпреступности, где он применяется не только для прямых атак, но и для проникновения в организации под видом легального трудоустройства [3].

Другим примечательным примером стало создание новых вариантов программ-вымогателей с помощью Claude. В отчёте описано, как киберпреступник использовал LLM для доработки и распространения нескольких разновидностей программ-вымогателей, каждая из которых оснащена продвинутыми методами обхода защиты, сильным шифрованием и механизмами против восстановления данных. Эти инструменты, усиленные ИИ, представляют серьёзную проблему для специалистов по кибербезопасности, поскольку они разработаны для обхода традиционных методов обнаружения и противодействия попыткам восстановления данных [3].

Параллельно с этими событиями исследователи ESET выявили новый программный продукт-вымогатель на базе ИИ под названием PromptLock, который сейчас находится на стадии proof-of-concept. Согласно отчёту, опубликованному 26 августа, PromptLock стал первым известным программным обеспечением-вымогателем, использующим генеративную модель ИИ для выполнения атаки. Вредоносное ПО использует модель OpenAI gpt-oss:20b, доступ к которой осуществляется через Ollama API, для динамической генерации вредоносных Lua-скриптов. Эти скрипты являются кроссплатформенными и могут работать на Windows, Linux и macOS, выполняя такие задачи, как перечисление файловой системы, эксфильтрация данных и шифрование [3].

PromptLock написан на Golang и был обнаружен как в вариантах для Windows, так и для Linux, отправленных на VirusTotal. Исследователи отметили, что вредоносное ПО пока не включает функцию уничтожения данных и, по-видимому, находится в стадии доработки. Тем не менее, обнаружение программ-вымогателей на базе ИИ на любой стадии разработки вызывает обеспокоенность у экспертов по кибербезопасности. Подход, используемый в PromptLock, соответствует технике «Internal Proxy», которая предполагает создание туннеля из скомпрометированной сети на удалённый сервер, где размещена модель ИИ. Эта тактика становится всё более распространённой в современных кибератаках, предоставляя злоумышленникам возможность обходить обнаружение и сохранять устойчивое присутствие [3].

Появление программ-вымогателей на базе ИИ и более широкое использование LLM для вредоносных целей свидетельствуют о расширяющемся ландшафте угроз, в котором киберпреступники быстро адаптируются к новым технологиям. По мере развития ИИ, вероятно, злоумышленники будут продолжать использовать эти инструменты для более сложных и автоматизированных киберопераций. Организации должны сохранять бдительность и инвестировать в надёжные меры кибербезопасности, чтобы снизить риски, связанные с этими новыми угрозами [3].

Источник:

Дисклеймер: содержание этой статьи отражает исключительно мнение автора и не представляет платформу в каком-либо качестве. Данная статья не должна являться ориентиром при принятии инвестиционных решений.

Вам также может понравиться

Правда о резком падении BTC: это не крах криптовалют, а глобальное сокращение кредитного плеча, вызванное шоком иены.

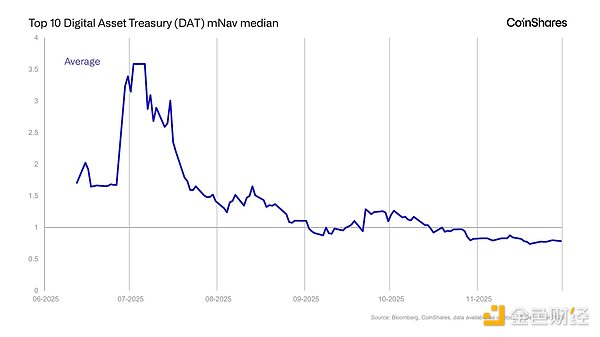

Компания DAT: концепция в процессе трансформа�ции

Виталик похвалил обновление Ethereum Fusaka.

Популярное

ДалееПравда о резком падении BTC: это не крах криптовалют, а глобальное сокращение кредитного плеча, вызванное шоком иены.

Ежедневный утренний отчет Bitget (4 декабря)|Solana Mobile выпустит токен SKR; основная сеть Ethereum успешно активировала обновление Fusaka; данные по первичным заявкам на пособие по безработице в США будут опубликованы сегодня в 21:30