Autor: Ma Leilei

Fonte: CHANNELWU

Buffett já disse: "Nunca invista em uma empresa que você não entende." No entanto, quando a "era do oráculo das ações" está prestes a terminar, Buffett tomou uma decisão que contradiz sua própria "regra da casa": comprou ações do Google, e ainda pagando um prêmio de cerca de 40 vezes o fluxo de caixa livre.

Sim, pela primeira vez Buffett comprou ações relacionadas à "temática de IA", não foi OpenAI, nem Nvidia. Todos os investidores estão fazendo a mesma pergunta: por que o Google?

Voltemos ao final de 2022. Naquela época, o ChatGPT surgiu de repente, a alta administração do Google soou o "alarme vermelho", fizeram reuniões contínuas e até convocaram urgentemente os dois fundadores de volta. Mas, naquele momento, o Google parecia um dinossauro lento e atolado em burocracia.

Lançou às pressas o chatbot Bard, mas cometeu um erro factual na demonstração, as ações da empresa despencaram e o valor de mercado evaporou em mais de 100 bilhões de dólares em um único dia. Em seguida, integrou suas equipes de IA e lançou o modelo multimodal Gemini 1.5.

No entanto, esse produto, considerado seu trunfo, só gerou algumas horas de discussão no círculo tecnológico antes de ser ofuscado pelo lançamento do modelo de geração de vídeo Sora pela OpenAI, rapidamente caindo no esquecimento.

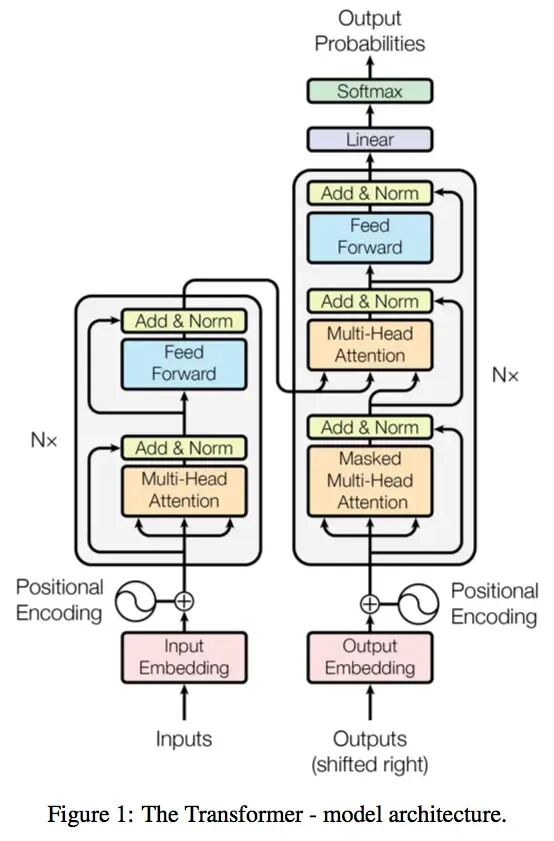

Um pouco constrangedor é o fato de que foram os pesquisadores do Google que, em 2017, publicaram o artigo acadêmico inovador que lançou as bases teóricas sólidas para esta revolução da IA.

Artigo "Attention Is All You Need"

Modelo Transformer proposto

Os concorrentes zombaram do Google. O CEO da OpenAI, Altman, desdenhou do gosto do Google: "Não consigo deixar de pensar nas diferenças estéticas entre OpenAI e Google."

O ex-CEO do Google também criticou a preguiça da empresa: "O Google sempre achou que o equilíbrio entre trabalho e vida... é mais importante do que vencer a concorrência."

Essa série de constrangimentos fez muitos duvidarem se o Google havia ficado para trás na corrida da IA.

Mas a mudança finalmente chegou. Em novembro, o Google lançou o Gemini 3, que superou os concorrentes, incluindo a OpenAI, na maioria dos benchmarks. Mais importante ainda, o Gemini 3 foi treinado inteiramente com chips TPU desenvolvidos internamente pelo Google, que agora são posicionados como alternativas de baixo custo aos GPUs da Nvidia e estão sendo vendidos em larga escala para clientes externos.

O Google mostrou sua força em duas frentes: respondeu diretamente à OpenAI na guerra de software com a série Gemini 3; e, na guerra de hardware, desafiou o domínio de longa data da Nvidia com seus chips TPU.

Chutando a OpenAI, socando a Nvidia.

Altman já sentiu a pressão no mês passado, dizendo em uma carta interna que o Google "pode trazer alguns ventos econômicos contrários temporários para nossa empresa". E nesta semana, após ouvir que grandes empresas estavam comprando chips TPU, a Nvidia viu suas ações despencarem 7% durante o pregão e precisou emitir uma carta para acalmar o mercado.

O CEO do Google, Sundar Pichai, disse recentemente em um podcast que os funcionários do Google deveriam descansar um pouco. "Do ponto de vista externo, pode ter parecido que estávamos quietos ou atrasados naquele período, mas, na verdade, estávamos consolidando todos os componentes básicos e, a partir disso, avançando com tudo."

Agora, a situação se inverteu. Pichai disse: "Já chegamos ao ponto de inflexão."

Neste momento, faz exatamente três anos desde o lançamento do ChatGPT. Nestes três anos, a IA desencadeou um banquete de capital e alianças em Silicon Valley; mas sob o banquete, surgem preocupações com bolhas. O setor chegou ao ponto de inflexão?

Ultrapassagem

Em 19 de novembro, o Google lançou seu mais novo modelo de inteligência artificial, o Gemini 3.

Um teste mostrou que, na maioria dos testes que abrangem conhecimento especializado, raciocínio lógico, matemática e reconhecimento de imagens, o Gemini 3 obteve pontuações significativamente superiores aos modelos mais recentes de outras empresas, incluindo o ChatGPT. Apenas em um único teste de programação seu desempenho foi um pouco inferior, ficando em segundo lugar.

O Wall Street Journal disse: "Pode-se chamá-lo de o modelo de próxima geração dos EUA." A Bloomberg afirmou que o Google finalmente acordou. Musk e Altman elogiaram o modelo. Alguns internautas brincaram que este é o GPT-5 idealizado por Altman.

O CEO da Box, plataforma de gerenciamento de conteúdo em nuvem, disse, após testar o Gemini 3 antecipadamente, que a melhoria de desempenho foi tão grande que eles chegaram a duvidar de seus próprios métodos de avaliação. Mas, após repetidos testes, confirmaram que o modelo venceu com vantagem de dois dígitos em todas as avaliações internas.

O CEO da Salesforce disse que usou o ChatGPT por três anos, mas o Gemini 3 mudou sua percepção em apenas duas horas: "Holy shit... não tem como voltar atrás. É um salto qualitativo, raciocínio, velocidade, processamento de texto, imagem e vídeo... tudo mais afiado e rápido. Parece que o mundo virou de cabeça para baixo de novo."

Gemini 3

Por que o desempenho do Gemini 3 é tão notável e o que o Google fez?

O líder do projeto Gemini postou: "Simples: melhoramos o pré-treinamento e o pós-treinamento." Algumas análises dizem que o pré-treinamento do modelo ainda segue a lógica da Scaling Law — otimizando o pré-treinamento (como usando dados em maior escala, métodos de treinamento mais eficientes, mais parâmetros, etc.) para melhorar as capacidades do modelo.

A pessoa mais curiosa sobre os segredos do Gemini 3 é, sem dúvida, Altman.

No mês passado, antes do lançamento do Gemini 3, ele já havia preparado os funcionários da OpenAI em uma carta interna: "De qualquer ponto de vista, o trabalho recente do Google é excelente", especialmente no pré-treinamento, onde o Google fez progressos que podem "trazer alguns ventos econômicos contrários temporários para a empresa", e "o ambiente externo será mais rigoroso por um tempo".

Embora, em termos de número de usuários, o ChatGPT ainda tenha uma vantagem significativa sobre o Gemini, a diferença está diminuindo.

Nesses três anos, o número de usuários do ChatGPT cresceu rapidamente. Em fevereiro deste ano, tinha 400 milhões de usuários ativos semanais, e neste mês saltou para 800 milhões. O Gemini divulgou dados mensais: em julho, tinha 450 milhões de usuários ativos mensais, e neste mês subiu para 650 milhões.

Com cerca de 90% de participação no mercado global de buscas, o Google naturalmente detém o canal principal para promover seus modelos de IA, podendo alcançar diretamente uma enorme base de usuários.

Atualmente, a OpenAI está avaliada em 500 bilhões de dólares, sendo a startup mais valiosa do mundo. É também uma das empresas de crescimento mais rápido da história, com receita saltando de quase zero em 2022 para uma estimativa de 13 bilhões de dólares este ano. Mas também prevê que, para alcançar a inteligência artificial geral, queimará mais de 100 bilhões de dólares nos próximos anos, além de gastar dezenas de bilhões alugando servidores. Em outras palavras, ainda precisará buscar financiamento.

O Google tem uma vantagem inegável: um caixa muito mais robusto.

O relatório financeiro mais recente do Google mostra que sua receita ultrapassou 100 bilhões de dólares pela primeira vez em um trimestre, chegando a 102,3 bilhões, um aumento de 16% em relação ao ano anterior, com lucro de 35 bilhões, um aumento de 33%. O fluxo de caixa livre da empresa é de 73 bilhões de dólares, e os investimentos em IA este ano chegarão a 90 bilhões.

Por enquanto, também não precisa se preocupar que o negócio de buscas seja canibalizado pela IA, já que buscas e publicidade continuam crescendo dois dígitos. O negócio de nuvem está em ascensão, até a OpenAI aluga seus servidores.

Além do fluxo de caixa autossustentável, o Google possui ativos que a OpenAI não consegue igualar, como uma enorme quantidade de dados prontos para treinar e otimizar modelos, além de infraestrutura computacional própria.

Em 14 de novembro, o Google anunciou um investimento de 40 bilhões de dólares em novos data centers

A OpenAI é habilidosa em negociações, assinando acordos de computação no valor de mais de 1 trilhão de dólares com várias partes. Por isso, quando o Google, com o Gemini, se aproxima rapidamente, os investidores ficam ainda mais desconfiados: será que o crescimento prometido pela OpenAI realmente vai cobrir o déficit?

Fissura

Um mês atrás, o valor de mercado da Nvidia ultrapassou 5 trilhões de dólares, e o entusiasmo do mercado por IA levou este "fornecedor de armas de IA" a um novo patamar. Mas os chips TPU usados pelo Gemini 3 do Google abriram uma fissura na fortaleza da Nvidia.

The Economist, citando dados da empresa de pesquisa Bernstein, afirma que os GPUs da Nvidia representam mais de dois terços do custo total de um rack típico de servidores de IA, enquanto os chips TPU do Google custam apenas de 10% a 50% do preço dos chips Nvidia de desempenho equivalente. Essas economias acumuladas são consideráveis. O banco de investimentos Jefferies estima que o Google produzirá cerca de 3 milhões desses chips no próximo ano, quase metade da produção da Nvidia.

No mês passado, a conhecida startup de IA Anthropic já planejava adotar em larga escala os chips TPU do Google, com rumores de que o valor do acordo chega a dezenas de bilhões de dólares. Em 25 de novembro, foi noticiado que a gigante de tecnologia Meta também está em negociações para usar chips TPU em seus data centers até 2027, num acordo de vários bilhões de dólares.

O CEO do Google, Sundar Pichai, apresenta o chip TPU

As grandes empresas de internet do Vale do Silício também estão apostando em chips, seja desenvolvendo internamente ou em parceria com fabricantes, mas nenhuma avançou tanto quanto o Google.

A história do TPU remonta a mais de dez anos. Na época, o Google começou a desenvolver um chip acelerador dedicado para uso interno, visando aumentar a eficiência de busca, mapas e tradução. Desde 2018, passou a vender TPUs para clientes de computação em nuvem.

Depois disso, os TPUs também passaram a ser usados no desenvolvimento interno de IA do Google. Durante o desenvolvimento de modelos como o Gemini, as equipes de IA e de chips interagiam: a primeira fornecia demandas e feedback, e a segunda otimizava os TPUs de acordo, aumentando a eficiência do desenvolvimento de IA.

Atualmente, a Nvidia detém mais de 90% do mercado de chips de IA. Seus GPUs foram originalmente projetados para renderizar gráficos de jogos, processando tarefas em paralelo com milhares de núcleos, arquitetura que também os tornou líderes em IA.

Já o TPU do Google é um ASIC (circuito integrado de aplicação específica), ou seja, um "especialista", projetado para tarefas computacionais específicas, sacrificando certa flexibilidade e aplicabilidade, mas com maior eficiência energética. O GPU da Nvidia é um "generalista", flexível e altamente programável, mas mais caro.

No entanto, neste estágio, nenhuma empresa, nem mesmo o Google, consegue substituir totalmente a Nvidia. Apesar dos TPUs já estarem na sétima geração, o Google ainda é um grande cliente da Nvidia. Um motivo óbvio é que o negócio de nuvem do Google atende milhares de clientes globalmente, e usar GPUs garante sua atratividade.

Mesmo empresas que compram TPUs precisam abraçar a Nvidia. Após anunciar a parceria com os TPUs do Google, a Anthropic logo anunciou um grande acordo com a Nvidia.

O Wall Street Journal afirma: "Investidores, analistas e operadores de data centers dizem que os TPUs do Google são uma das maiores ameaças ao domínio da Nvidia no mercado de computação de IA, mas para desafiar a Nvidia, o Google precisa começar a vender esses chips mais amplamente para clientes externos."

Os chips de IA do Google tornaram-se uma das poucas alternativas aos chips da Nvidia, o que impactou diretamente o preço das ações da Nvidia. A Nvidia precisou publicar uma mensagem para acalmar o pânico do mercado causado pelos TPUs. Disse estar "feliz pelo sucesso do Google", mas enfatizou que a Nvidia está uma geração à frente do setor, e seu hardware é mais versátil do que os TPUs e outros chips especializados.

A Nvidia também enfrenta a pressão do mercado quanto ao temor de uma bolha, já que investidores temem que o enorme investimento de capital não se traduza em lucros. O sentimento do investidor pode mudar rapidamente: temem tanto que o negócio da Nvidia seja tomado quanto que os chips de IA não vendam.

O famoso "short seller" americano Michael Burry disse que apostou mais de 1 bilhão de dólares contra empresas de tecnologia como a Nvidia. Ele ficou famoso por apostar contra o mercado imobiliário dos EUA em 2008, história que virou o filme "A Grande Aposta". Ele diz que o frenesi atual da IA é semelhante à bolha da internet do início dos anos 2000.

Michael Burry

A Nvidia distribuiu um documento de sete páginas para analistas, rebatendo as críticas de Burry e outros. Mas o documento não acalmou a controvérsia.

Modelo

O Google está vivendo dias doces, com suas ações subindo na contramão da bolha de IA. A empresa de Buffett comprou suas ações no terceiro trimestre, o Gemini 3 recebeu respostas positivas, e os chips TPU animaram os investidores, levando o Google a um novo patamar.

No último mês, ações de empresas de IA como Nvidia e Microsoft caíram mais de 10%, enquanto as ações do Google subiram cerca de 16%. Atualmente, com valor de mercado de 3,86 trilhões de dólares, ocupa o terceiro lugar mundial, atrás apenas da Nvidia e da Apple.

Os analistas chamam o modelo de IA do Google de integração vertical.

Como um dos raros players "full stack" do setor de tecnologia, o Google mantém toda a cadeia sob seu controle: implanta chips TPU próprios na Google Cloud, treina seus próprios grandes modelos de IA, e esses modelos podem ser integrados perfeitamente a negócios centrais como busca e YouTube. A vantagem desse modelo é clara: não depende da Nvidia, possui soberania computacional eficiente e de baixo custo.

Outro modelo é o mais comum de aliança flexível. Os gigantes dividem funções: a Nvidia fornece GPUs, OpenAI, Anthropic e outros desenvolvem modelos de IA, e gigantes da nuvem como Microsoft compram GPUs dos fabricantes para hospedar os modelos desses laboratórios de IA. Nesse ecossistema, não há aliados ou rivais absolutos: colaboram quando possível, competem quando necessário.

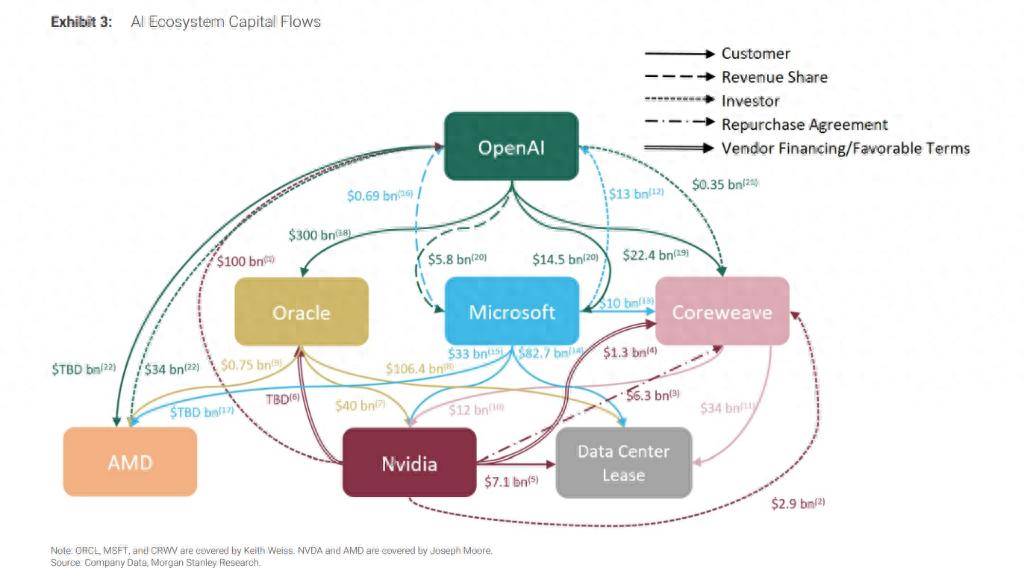

Os players formam uma "estrutura circular", com o capital circulando em loop entre alguns poucos gigantes da tecnologia.

Normalmente, o ciclo funciona assim: a empresa A paga à empresa B (como investimento, empréstimo ou aluguel), a empresa B usa esse dinheiro para comprar produtos ou serviços da empresa A, e sem esse "capital inicial", B talvez nem pudesse comprar.

Um exemplo: a OpenAI gasta 300 bilhões de dólares com a Oracle para computação, a Oracle usa parte desse dinheiro para comprar chips da Nvidia e construir data centers, e a Nvidia investe até 100 bilhões de dólares na OpenAI — com a condição de que continue usando seus chips. (OpenAI paga 300 bilhões à Oracle → Oracle usa o dinheiro para comprar chips Nvidia → Nvidia investe o lucro de volta na OpenAI.)

Esses casos geram diagramas financeiros labirínticos. Analistas do Morgan Stanley, em relatório de 8 de outubro, usaram uma foto para ilustrar o fluxo de capital no ecossistema de IA do Vale do Silício. Eles alertam que a falta de transparência dificulta para os investidores entenderem os riscos e retornos reais.

O Wall Street Journal comentou sobre essa imagem: "As setas que as conectam são tão intrincadas quanto um prato de espaguete."

Impulsionada pelo capital, a silhueta desse gigante está esperando para tomar forma, mas ninguém sabe como será. Alguns estão assustados, outros animados.